深度学习

自动化

设计模式

http

node.js

st-link

elk

GPT-4

池化

数据介绍

lstm

Java项目

可视化

SAP PI接口归档

尖括号和双引号的区别

python常见错误

期权PCR

哈希表

POM

vue3官方文档

熵

2024/4/11 15:26:59【Python】近似熵,样本熵,模糊熵计算高效版

文章目录前言整体思路1 近似熵(Approximate Entropy, ApEn)1.1 理论基础1.2 python第三方库实现1.3 基于多线程numpy矩阵运算实现2 样本熵 (Sample Entropy, SampEn)2.1 理论基础2.2 python第三方库实现2.3 基于多线程numpy矩阵运算实现3 模糊熵3.1 理论基础3.2 python第三方库…

连续特征离散化的方法

在特征工程中,特别是logisticregression上,需要把一些连续特征进行离散化处理。离散化除了一些计算方面等等好处,还可以引入非线性特性,也可以很方便的做cross-feature。离散特征的增加和减少都很容易,易于模型的快速迭…

样本熵及其matlab实现方法

一、样本熵概述

样本熵是一种衡量数据无序性的量化指标,它是通过测量样本的多样性来计算的。与其他熵的概念不同的是,样本熵是基于统计学的理论推导而得出的熵,而不是基于热力学理论推导的。

在实际应用中,样本熵可以被应用于特…

非线性动力学方法提取生物信号特征

非线性动力学方法中的熵,可以作为信号整体的特征,例如PPG、ECG、EEG等。但是要注意熵的运算复杂度一般比较高,在嵌入式设备上运行时长、速度、功耗都难满足。在嵌入式设备上需要优化或者找到替代熵的特征提取方式,最近,…

人生百相,不过熵增熵减

这篇博文由两个问题衍生而来,分别是:“为什么除法比加法困难”、“什么是生命进化的目的”。在阅读其他人的解读时,发现都关联到了一个概念,熵。觉得十分有意思,因此记录一下自己的遐想。 熵(Entropy&#…

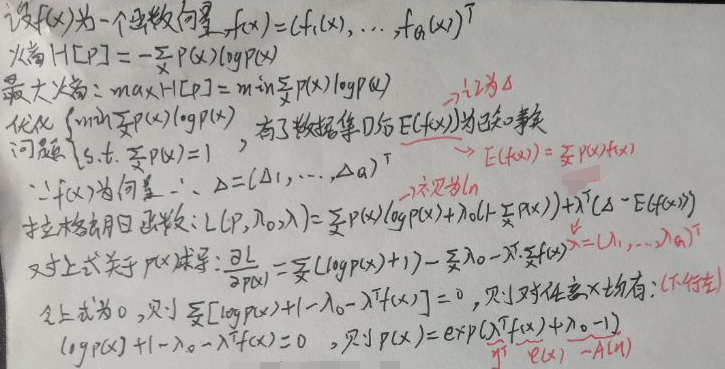

机器学习-白板推导-系列(八)笔记:指数族分布/充分统计量/对数配分函数/最大熵

文章目录0 笔记说明1 背景1.1 指数族分布的一般形式1.2 共轭先验2 高斯分布的指数族形式3 对数配分函数与充分统计量4 极大似然估计与充分统计量5 熵5.1 最大熵⇔x服从均匀分布5.2 最大熵原理0 笔记说明

来源于【机器学习】【白板推导系列】【合集 1~23】ÿ…

一篇文章彻底搞懂熵、信息熵、KL散度、交叉熵、Softmax和交叉熵损失函数

文章目录 一、熵和信息熵1.1 概念1.2 信息熵公式 二、KL散度和交叉熵2.1 KL散度(相对熵)2.2 交叉熵 三、Softmax和交叉熵损失函数3.1 Softmax3.2 交叉熵损失函数 一、熵和信息熵

1.1 概念 1. 熵是一个物理学概念,它表示一个系统的不确定性程度,或者说是…

信息熵、相对熵与交叉熵

目录1. 信息熵2. 相对熵3. 交叉熵4. 交叉熵与softmax1. 信息熵 熵是一个信息论中的概念,表示随机变量不确定的度量,是对所有可能发生的事件产生的信息量的期望。信息熵公式如下: H(p)−∑i1np(xi)logp(xi)H(p)-\sum_{i1}^{n}{p(x_i)logp(x_i)…

与信息熵相关的概念梳理(条件熵/互信息/相对熵/交叉熵)

香农信息量

信息量表示不确定性的大小。 信息量的单位是比特(bit)。 香农信息量log1p−logp(以2为底)香农信息量\log\frac{1}{p}-\log p\quad(以2为底)香农信息量logp1−logp(以2为底)

上式中,p越小,则不确定性越大&#…